Une étude mondiale dévoile les peurs face à l’IA dans le travail

Une récente étude menée auprès de plus de 10 000 personnes dans 20 pays met en lumière les inquiétudes grandissantes autour du remplacement des humains par l’intelligence artificielle (IA) dans divers métiers. Publiée par des chercheurs du Max Planck Institute for Human Development, cette enquête étudie les réactions face à l’IA dans six professions clé : médecins, juges, managers, soignants, leaders religieux et journalistes. Les résultats révèlent des différences marquées entre les pays, mais aussi une constante : la peur surgit dès que les capacités perçues de l’IA semblent inadaptées aux exigences humaines d’un métier.

Des réactions dictées par les qualités humaines attendues

Les participants ont évalué ces métiers à travers huit traits psychologiques : chaleur, sincérité, tolérance, équité, compétence, détermination, intelligence et imagination. Ils ont ensuite estimé dans quelle mesure l’IA pouvait reproduire ces qualités et exprimé leurs craintes face à son adoption. Le lien est clair : plus l’écart entre les attentes humaines et les capacités supposées de l’IA est grand, plus la peur augmente. Par exemple, un juge doit faire preuve d’équité et de jugement moral, des domaines où l’IA est souvent perçue comme déficiente, ce qui explique les fortes réticences à son égard.

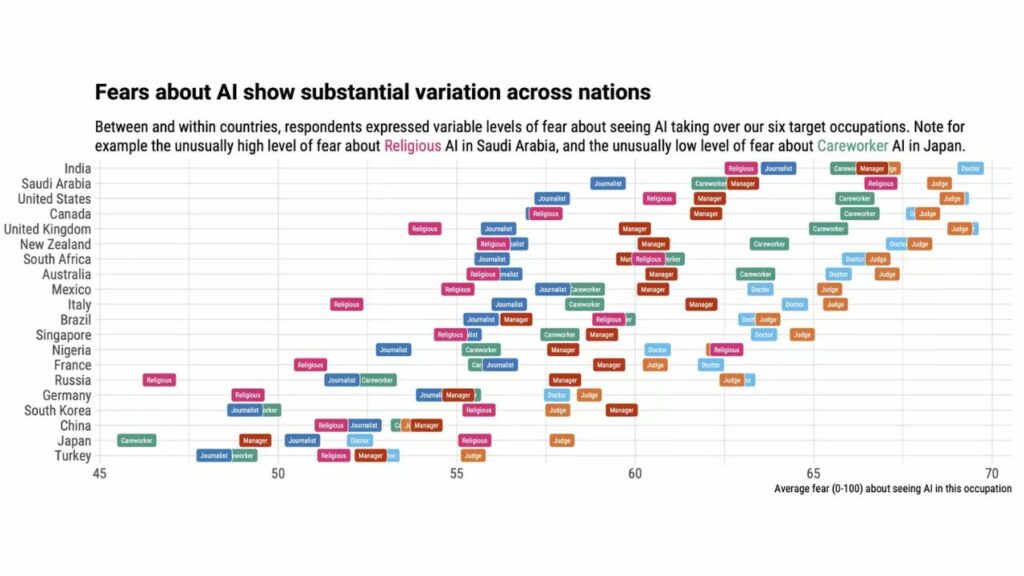

Des différences culturelles frappantes

Les niveaux de peur varient considérablement d’un pays à l’autre. L’Inde, l’Arabie saoudite et les États-Unis se distinguent par des craintes élevées, notamment pour les rôles de juges et de médecins. À l’inverse, la Turquie, le Japon et la Chine affichent une sérénité relative, probablement influencée par des expériences historiques avec la technologie, des récits médiatiques ou des politiques locales favorables à l’IA. L’Allemagne, elle, se situe dans une position intermédiaire, révélant une prudence teintée d’optimisme. Ces écarts suggèrent que les attitudes envers l’IA dépendent fortement du contexte culturel.

Les juges, champions des craintes mondiales

Parmi les métiers étudiés, celui de juge suscite les plus vives inquiétudes, et ce dans presque tous les pays. Les participants redoutent qu’une IA manque de transparence, d’équité ou de capacité à saisir les nuances morales d’une décision judiciaire. À l’opposé, les journalistes alimentés par l’IA génèrent le moins de peur. Pourquoi ? Les lecteurs conservent un contrôle sur la manière dont ils consomment l’information, contrairement aux verdicts judiciaires, qui s’imposent sans marge de manœuvre.

Médecins et soignants : l’empathie en question

Pour les médecins et les soignants, les réactions sont plus nuancées mais souvent marquées par l’inquiétude. Dans certains pays, l’idée d’un diagnostic ou d’un soin prodigué par une machine soulève des doutes sur sa capacité à faire preuve d’empathie ou de compréhension émotionnelle. Mengchen Dong, première autrice de l’étude, note que ces réactions négatives émergent dès que l’IA entre dans un domaine où l’humain est jugé irremplaçable. Une étude antérieure sur les managers IA avait déjà pointé des résistances similaires, surtout pour des tâches nécessitant écoute ou respect.

Des solutions pour apaiser les tensions

Les chercheurs ne se contentent pas de diagnostiquer les peurs : ils proposent des pistes pour les atténuer. Pour les médecins IA, par exemple, une transparence accrue dans les décisions et un positionnement comme outil d’appui aux praticiens humains pourraient rassurer. Concernant les juges, des algorithmes axés sur l’équité, couplés à des campagnes d’information publique, pourraient réduire les appréhensions. “Il ne s’agit pas d’imposer l’IA uniformément, mais de l’adapter aux attentes culturelles et psychologiques”, explique Iyad Rahwan, co-auteur et directeur du Center for Humans and Machines.

Une IA culturellement adaptée ?

L’étude insiste sur un point clé : une approche universelle de l’IA risque d’échouer. Les développeurs et décideurs doivent tenir compte des valeurs propres à chaque société pour favoriser l’acceptation. Par exemple, là où l’empathie prime, l’IA pourrait être reléguée à un rôle secondaire ; là où la compétence technique est valorisée, elle pourrait prendre plus de place. Ce cadre pourrait guider une intégration éthique et efficace de l’IA à l’échelle mondiale.

Et demain ?

Les travaux de Dong et de son équipe ne s’arrêtent pas là. Ils explorent désormais comment les visions utopiques ou dystopiques de l’IA influencent les attitudes actuelles. Ces recherches promettent d’éclairer davantage les interactions entre humains et machines, tout en offrant des bases pour une adoption respectueuse des diversités culturelles. En attendant, une chose est certaine : la peur de l’IA dans le travail ne disparaîtra pas sans un effort concerté pour aligner ses capacités sur ce que les gens attendent profondément des métiers qu’ils chérissent.